以前ChatGPTで、GPT-4を使って特許出願書類の発明の背景技術がどこまでかけそうか試してみました。

www.patent-topics-explorer.com

一方で、ChatGPTの問題点としてhallucinationが生じ、”自信をもって嘘をつく”という大きな問題が一般的に言われています。実際に背景技術を記載してみると、非特許文献1として挙げられた文献は実際に存在しないということもままありました。

一方で、ChatGPTですが、5月12日にWeb browsing plug-inが有料版で使えるようになったようで、実際にネットを検索して回答ができる機能が追加されたそうです。

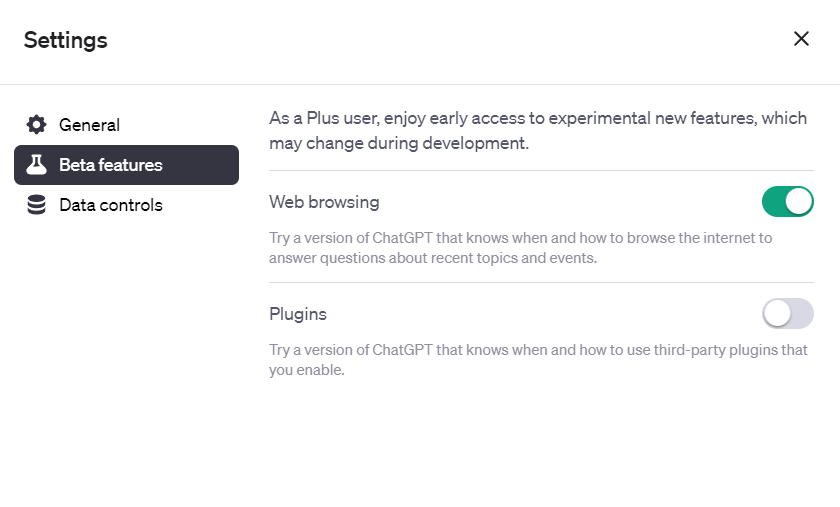

一方、いつまでたってもプラグイン出てこないなーと思ったのですが、Settingsという設定画面を開き、Web browsingを下記のように有効にしないと出てくれないそうです。

というわけで、満を持してWeb browsing機能を有効にして、以前と同様に下記の条件で背景技術を出力させてみました。

今回の発明: トランスフォーマーアルゴリズムを用いた専門知識を有するチャットボットの発明。

背景技術: ですます調は用いない。

非特許文献: 日本の非特許文献の記載に合わせる。簡単な要約をつける。

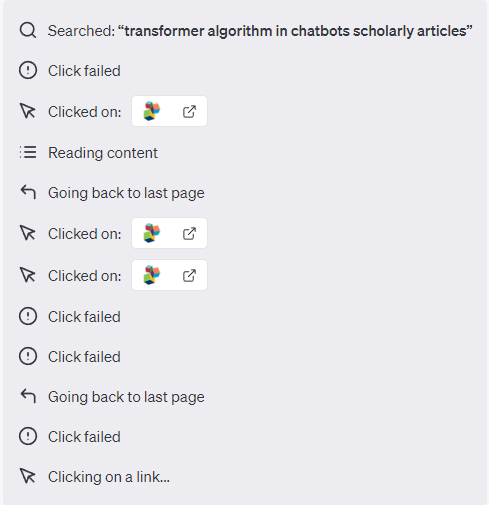

まず、難点としては結構時間がかかります。出力するまでに10分くらいかかりました。

実際に出力過程をみてみると、下記の参照先がChatGPTが読み込めず頑張っていることが多く、さらにそこから参照先の読み込みや文章起案もするので、結構時間がかかっているようです。

出力としては、下記が出てきました。

【背景技術】

チャットボット技術は、人間とコンピュータの対話を可能にする技術であり、人工知能の一部分野として発展してきました。これらのチャットボットは大きく分けて、オープンドメインのチャットボットとクローズドドメインのチャットボットに分けることができます。オープンドメインのチャットボットは、広範囲のトピックについて人間との対話を模倣する能力を持ち、ソーシャル化、エンターテイメント、感情的な付き合い、マーケティングなどに広く活用されています。一方、クローズドドメインのチャットボットは、特定のタスクを達成するために設計され、注文の配置からカスタマーサポートまでの範囲のタスクを担当します。しかし、ボットが新しいシナリオで人間の入力が必要になる状況は常に存在します。これは、ボットが予期していない問題を提示する顧客や、ナンセンスな入力に対応しようとする場合、あるいは単純なスペルミスに対応する場合などがあります【9†source】。

【非特許文献】

【非特許文献1】Shi Yu, Yuxin Chen, Hussain Zaidi, "AVA: A Financial Service Chatbot Based on Deep Bidirectional Transformers," Frontiers in Applied Mathematics and Statistics, The Vanguard Group, Malvern, PA, United States, 2021. 本文献では、BERT(Bidirectional Encoder Representations from Transformers)モデルを使用した金融サービス向けのチャットボットを開発しました。このチャットボットは、クライアントの質問に対応し、認識できる意図は381種類あります。また、このモデルは「I don't know」を適切に発するタイミングを認識し、不確定またはエスカレーションが必要な質問を人間のオペレーターにエスカレートする能力を持っています。BERTの不確実性を測定するための新規の貢献として、3つの異なるアプローチを実問題と比較して系統的に評価しています。また、BERTを使用した言語モデルとしての自動スペル修正の使用も新規の貢献とされています【9†source】.

また、実際に下記が参照されたこともわかります。

Frontiers | AVA: A Financial Service Chatbot Based on Deep Bidirectional Transformers

一方で、ですます調を使わないといった細かいリクエストは結構忘れられてしまうことが多そうでした。

ちなみに以前のGPT-4で出力したものは下記になりますが、こちらは細かい指示も結構守ってくれます。

【背景技術】 トランスフォーマーアルゴリズムを用いた専門知識を有するチャットボット技術は、近年急速に発展している。従来の技術においては、専門知識の習得に時間がかかり、多様な応答が難しいという課題があった。例えば、Vaswaniらにより提案されたAttention Is All You Need (非特許文献1参照)は、トランスフォーマーアルゴリズムの基礎を築き、自然言語処理の精度向上を図るために開発された。しかし、このアルゴリズムは専門知識の習得やチャットボットへの応用に関しては限定的であった。

【非特許文献】

【非特許文献1】Vaswani, A., Shazeer, N., Parmar, N., Uszkoreit, J., Jones, L., Gomez, A. N., ... & Polosukhin, I. (2017). Attention is all you need. In Advances in Neural Information Processing Systems (NIPS), United States, Curran Associates, Inc., 2017年12月, 30, pp. 5998-6008.

現状ソースも示し、細かい制限も遵守させて、といった両方の要求を満たすのは難しいのかもしれないですね。今後のChatGPTは機能が拡充されていくと思うので、定期的に能力を評価してみようと思います。